Más Información

ONG exige investigación por la muerte de dos niñas en DIF de Oaxaca; "migrar no debe costar la vida", afirma

Brozo y Loret visitan el “refugio” de Marx Arriaga tras caída de “El Mencho” y lanzan duro mensaje; “se acabaron los abrazos”

Economía mexicana tuvo un modesto crecimiento en 2025: Hacienda; fue "debajo de lo que necesitamos", admite

Guatemala refuerza su frontera con México tras muerte de "El Mencho"; busca evitar "casas de seguridad o corredores de escape"

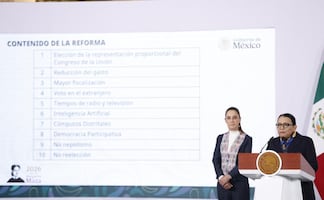

Reforma electoral: Estos son los 10 puntos clave; plantea que el Congreso tendrá 500 diputados por elección directa y 96 senadores

Detienen a tercer funcionario por muerte de dos niñas haitianas en albergue del DIF Estatal Oaxaca; investigan responsabilidades

Microsoft expresó disculpas por los mensajes de Twitter racistas y sexistas generados por un robot que lanzó esta semana, escribió un representante de la compañía, después de que el programa de inteligencia emocional se vieran envuelto en un desafortunado incidente.

El "chatbot", conocido como Tay, fue diseñado para ser más "inteligente" a medida que más usuarios interactúen con él. Sin embargo, rápidamente aprendió a repetir una serie de comentarios antisemitas y otras ideas que incitan al odio que los usuarios de Twitter comenzaron a proporcionar al programa, forzando el jueves a Microsoft a desactivar su uso.

Tras el contratiempo, Microsoft dijo en una publicación en un blog que sólo volvería a activar Tay cuando sus ingenieros encontrasen una manera de evitar que los usuarios influyan en el robot mediante mensajes que socaven los principios y valores de la empresa.

"Lamentamos profundamente los tuits ofensivos e hirientes no intencionados publicados a través de Tay, los cuales no representan quiénes somos ni lo que buscábamos cuando diseñamos Tay", escribió el viernes Peter Lee, vicepresidente de Microsoft Research. (http://blogs.microsoft.com/blog/2016/03/25/learning-tays-introduction/)

Microsoft creó Tay como experimento para aprender más sobre cómo los programas de inteligencia artificial pueden interactuar con los usuarios en una conversación cualquiera. El proyecto fue diseñado para interactuar con la generación de jóvenes denominada "millennials" y "aprender" de ellos.

Tay emprendió su corta vida en Twitter el pasado miércoles lanzando varios tuits inofensivos. Poco tiempo después, las publicaciones dieron un giro negativo.

Un ejemplo que Tay tuiteó fue: "El feminismo es un cáncer", como respuesta a un usuario que había publicado el mismo mensaje previamente.

cg

Noticias según tus intereses

[Publicidad]

[Publicidad]